„Neuronales Netz ohne Dirigenten“

Dirk Eidemüller

CoreDesignKEY/iStock

Welt der Physik: Warum ist die Datenverarbeitung in neuronalen Netzwerken so schwer nachzuvollziehen?

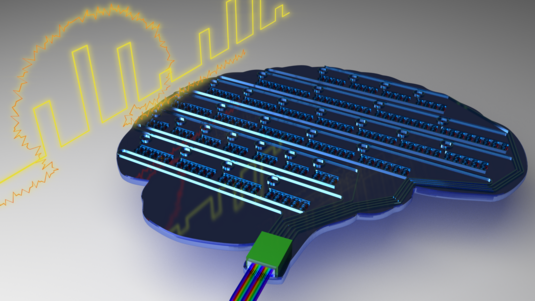

Andreas Schneider: Sowohl biologische neuronale Netzwerke – also zum Beispiel unser Gehirn – als auch die davon inspirierten künstlichen neuronalen Netzwerke verarbeiten Daten ganz anders als herkömmliche Computerprogramme. Ein typisches Computerprogramm geht sequenziell vor, arbeitet sich also Schritt für Schritt voran. In einem neuronalen Netz hingegen verteilt sich die Rechenlast parallel über viele verschiedene Knotenpunkte. Die Informationen werden deshalb nicht an bestimmten Punkten verarbeitet, sondern verteilen sich über das ganze Netz – oder zumindest über gewisse Bereiche davon. Gerade bei größeren Netzwerken kann man kaum noch verstehen, was das Netzwerk eigentlich macht. Ob seine Tätigkeit sinnvoll ist, lässt sich dann nur noch am Output erkennen.

Sie und Ihr Team haben nun einen neuen Typ von neuronalen Netzwerken entwickelt. Worin unterscheidet sich Ihr Typ von den bisherigen?

Unsere Idee war es, uns wieder stärker am biologischen Vorbild zu orientieren. Dort wird die Informationsverarbeitung stärker lokal – also in bestimmten Bereichen des Netzwerks – organisiert und nicht über das gesamte Netz verteilt. Die Lernprozesse der Neuronen werden so vor allem von ihrem direkten Umfeld im Netzwerk bestimmt. Dadurch ist es einfacher, die Lernprozesse nachzuvollziehen und das Verhalten des Netzwerks sinnvoll zu interpretieren.

Wie haben Sie den neuen Typ entwickelt?

Wir haben dazu eine neuartige Version der Informationstheorie benutzt, die sogenannte „partielle Informationszerlegung“. Dank dieses theoretischen Unterbaus können wir für einzelne Neuronen sogenannte Zielfunktionen definieren, die vorgeben, wie die Neuronen Informationen aus unterschiedlichen Quellen kombinieren und weitergeben sollen. Bei herkömmlichen künstlichen neuronalen Netzwerken lässt sich das nicht bewerkstelligen. Dort bekommt nur das Netzwerk als Ganzes bestimmte Aufgaben, deren Lösung sich dann irgendwie über das Netz verteilt.

Und wie genau verteilen sich dann die Informationen in Ihrem neuen Netzwerk?

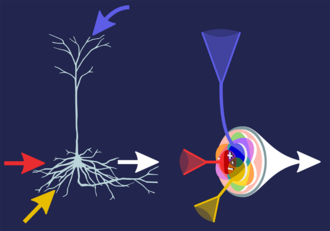

Bei unserem neuronalen Netz können benachbarte Neuronen die zu verarbeitende Information selbstständig untereinander aufteilen, sodass verschiedene Neuronen unterschiedliche Aspekte des Informationsgehalts repräsentieren. Als Inspiration dafür haben uns die sogenannten Pyramidenzellen im menschlichen Gehirn gedient. Diese verarbeiten Reize aus ihrer unmittelbaren Umgebung im Gehirn und machen dabei Lernprozesse durch.

Was heißt das für die Aufgabenverteilung der Neuronen?

Bisher haben wir sehr abstrakt darüber gesprochen. Aber in der Praxis geht es zum Beispiel um die Klassifikation, ob ein Bild einen Hund oder eine Katze darstellt. Dann vergleichen in unserem Netz bestimmte Neuronen oder Neuronenverbände die Form der Ohren oder der Nase. Das funktioniert nicht immer ganz exakt. Denn die Neuronen können sich die Informationen nicht immer perfekt aufteilen. Dennoch bestimmt diese Organisation der Informationsverarbeitung lokal die Struktur der Netzwerke. Deshalb haben wir unsere Bausteine auch „infomorphe Neuronen“ genannt.

Was bedeutet das für das Training des Netzwerks?

Beim Training unseres Netzwerks müssen den Neuronen neben der Zielfunktion zusätzliche Signale als Kontext gesendet werden, zum Beispiel zur Gesamtaufgabe des Netzwerks. Aber beim Lernen organisiert sich das Netzwerk dann selbstständig. Man braucht keine Optimierung „von außen“, wie es bei bisherigen künstlichen neuronalen Netzen notwendig ist. Wenn man es mit einem Orchester vergleicht, das ein neues Stück lernt, dann kann man sagen, die bisherigen Netzwerke brauchen einen Dirigenten, unsere hingegen kommen ohne Dirigenten aus. Dafür ist bei unseren Netzwerken die Vorbereitung des Trainings etwas aufwendiger.

Wo stehen Ihre Netzwerke im Vergleich mit den etablierten Modellen?

Wir können in einfachen Fällen bereits fast vergleichbare Leistungen erzielen. Bislang arbeiten wir aber nur mit rund 2000 künstlichen Neuronen, also mit eher kleinen Netzwerken. Was uns gegenwärtig noch schwer fällt, ist das Einrichten sogenannter tiefer Netzwerke, die mehr als nur ein paar Schichten von Neuronen aufweisen. Bei den großen Netzwerken der heutigen künstlichen Intelligenz sind es gerade die tiefen Netze mit vielen Verarbeitungsschichten, die zu den überraschenden Durchbrüchen der letzten Jahre geführt haben.

Denken Sie, dass Ihr Netzwerk als künstliche Intelligenz in Zukunft genutzt werden kann?

Wir werden sehen, ob sich auch unsere infomorphen Neuronen dafür eignen. Aber man darf nicht vergessen, dass es auch bei der jetzigen künstlichen Intelligenz viele Jahre an Entwicklungsarbeit gebraucht hat, bis diese tiefen neuronalen Netzwerke ihr großes Potenzial abrufen konnten. Dafür musste an vielen Stellschrauben gedreht werden. Wir stehen mit unseren infomorphen Neuronen ja noch ganz am Anfang.

Quelle: https://www.weltderphysik.de/gebiet/technik/maschinelles-lernen/kuenstliche-intelligenz-neuronales-netz-ohne-dirigenten/